Pourquoi les moteurs IA ne citent pas votre école

ChatGPT, Perplexity et Google AI Overviews ne fonctionnent pas comme un moteur de recherche classique. Ils ne classent pas des pages web par pertinence. Ils synthétisent des réponses à partir de corpus massifs, et citent les sources qu'ils jugent fiables, structurées et factuellement vérifiables.

En France, seulement 23 % des réponses générées par ChatGPT sur l'enseignement supérieur mentionnent une école par son nom (Source : Monitoring GEO Skolbot, 500 requêtes x 6 pays x 3 moteurs IA, fév. 2026). Sur Perplexity, le chiffre monte à 31 %, car ce moteur cite systématiquement ses sources. Les 69 à 77 % restants ? Des réponses génériques sans mention d'établissement. Votre contenu existe, mais il n'est pas citable.

La différence entre un contenu que l'IA ignore et un contenu qu'elle cite tient à quatre facteurs : la structure technique, la spécificité des données, l'autorité des sources et la clarté des réponses. Chaque facteur est actionnable.

Ce qui rend un contenu "citable" par un LLM

La structure prime sur la longueur

Un LLM ne lit pas un article de blog du début à la fin. Il extrait des fragments de réponse à partir de patterns reconnaissables : des paires question-réponse, des tableaux comparatifs, des définitions encadrées par des balises sémantiques. Un article de 3 000 mots sans structure claire a moins de chances d'être cité qu'une page de 800 mots avec des H2 informatifs, un tableau et une FAQ balisée.

Les signaux structurels que les LLM exploitent :

| Signal | Impact sur la citabilité | Difficulté d'implémentation |

|---|---|---|

| FAQ balisée en JSON-LD | Élevé — extraction directe | Faible |

| Tableaux avec en-têtes descriptifs | Élevé — données comparables | Faible |

| H2/H3 formulés en questions | Moyen — matching sémantique | Faible |

| Schema.org EducationalOrganization | Élevé — identification d'entité | Moyenne |

| Données chiffrées sourcées | Élevé — factuel vérifiable | Moyenne |

La spécificité bat la généralité

Un contenu qui affirme « notre école propose d'excellents programmes » ne sera jamais cité. Un contenu qui précise « 94 % de nos diplômés 2025 ont trouvé un emploi dans les 6 mois, salaire médian 42 000 € brut, enquête CGE sur 312 répondants » sera extrait par le moteur IA comme preuve factuelle.

Les données que les moteurs IA recherchent activement sur les sites d'écoles :

- Taux d'insertion professionnelle (avec méthodologie et taille d'échantillon)

- Frais de scolarité par programme et par année

- Accréditations officielles (AACSB, EQUIS, AMBA, CTI, visa)

- Classements avec source et année (SIGEM, L'Étudiant, QS)

- Nombres d'étudiants, de nationalités, de partenariats internationaux

4 techniques pour rendre votre contenu citable

1. Implémentez Schema.org sur vos pages clés

Les écoles avec Schema.org structuré obtiennent en moyenne +12 points de visibilité dans les réponses des moteurs IA (Source : Monitoring GEO Skolbot, 500 requêtes x 6 pays x 3 moteurs IA, fév. 2026). Le balisage EducationalOrganization transforme votre école d'un bloc de texte en une entité identifiable. Le balisage Course fait de même pour chaque programme.

Pour aller plus loin sur l'implémentation technique, consultez notre guide complet Schema.org pour les écoles.

L'implémentation minimale couvre trois schémas :

- EducationalOrganization sur la page d'accueil et la page « À propos »

- Course sur chaque page de programme

- FAQPage sur les pages FAQ et les articles de blog contenant des Q&A

Les champs qui comptent le plus pour les LLM : accreditation, numberOfStudents, aggregateRating, alumni et programPrerequisites. Ce sont les données que ChatGPT croise avec les bases de la CNIL, du Ministère de l'Enseignement Supérieur et de Campus France pour valider la fiabilité.

2. Structurez chaque page avec des réponses directes

Les moteurs IA fonctionnent sur un modèle question-réponse. Pour maximiser vos chances d'être cité, chaque H2 doit poser ou sous-entendre une question, et les 1-2 premières phrases doivent y répondre directement. Le reste du paragraphe apporte contexte et nuance.

Avant :

« Notre programme Grande École est reconnu pour la qualité de sa formation et son ouverture internationale, avec de nombreux partenariats à travers le monde. »

Après :

« Le programme Grande École de [École] dure 5 ans, coûte 12 500 €/an et conduit à un taux d'emploi de 94 % à 6 mois (enquête CGE 2025, 312 répondants). Il inclut 187 partenariats dans 45 pays et est accrédité EQUIS et AMBA. »

La seconde version contient six données vérifiables. La première, zéro.

3. Créez des tableaux comparatifs avec vos données

Les tableaux sont le format le plus extractible par un LLM. Un tableau propre avec des en-têtes clairs et des données chiffrées sera préféré à un paragraphe narratif contenant les mêmes informations.

Exemple de tableau citable pour une page programme :

| Critère | Programme Grande École | MBA |

|---|---|---|

| Durée | 5 ans | 2 ans |

| Frais annuels | 12 500 € | 28 000 € |

| Taux d'insertion à 6 mois | 94 % | 97 % |

| Salaire médian 1er emploi | 42 000 € | 62 000 € |

| Accréditations | EQUIS, AMBA | AMBA |

| Places disponibles | 400 | 60 |

Publiez ce type de tableau sur vos pages programmes, pas uniquement dans des PDF téléchargeables. Les moteurs IA ne lisent pas les PDF hébergés derrière un formulaire.

4. Ajoutez des sections FAQ balisées

Une section FAQ sert deux objectifs : elle répond aux questions que les prospects posent aux moteurs IA, et le balisage FAQPage en JSON-LD permet une extraction structurée.

L'erreur courante : rédiger des FAQ marketing (« Pourquoi choisir notre école ? ») au lieu de FAQ informatives (« Quel est le taux de sélectivité du programme Grande École ? »). Les moteurs IA favorisent les secondes.

Pour diagnostiquer votre situation actuelle, utilisez notre outil de diagnostic de visibilité ChatGPT.

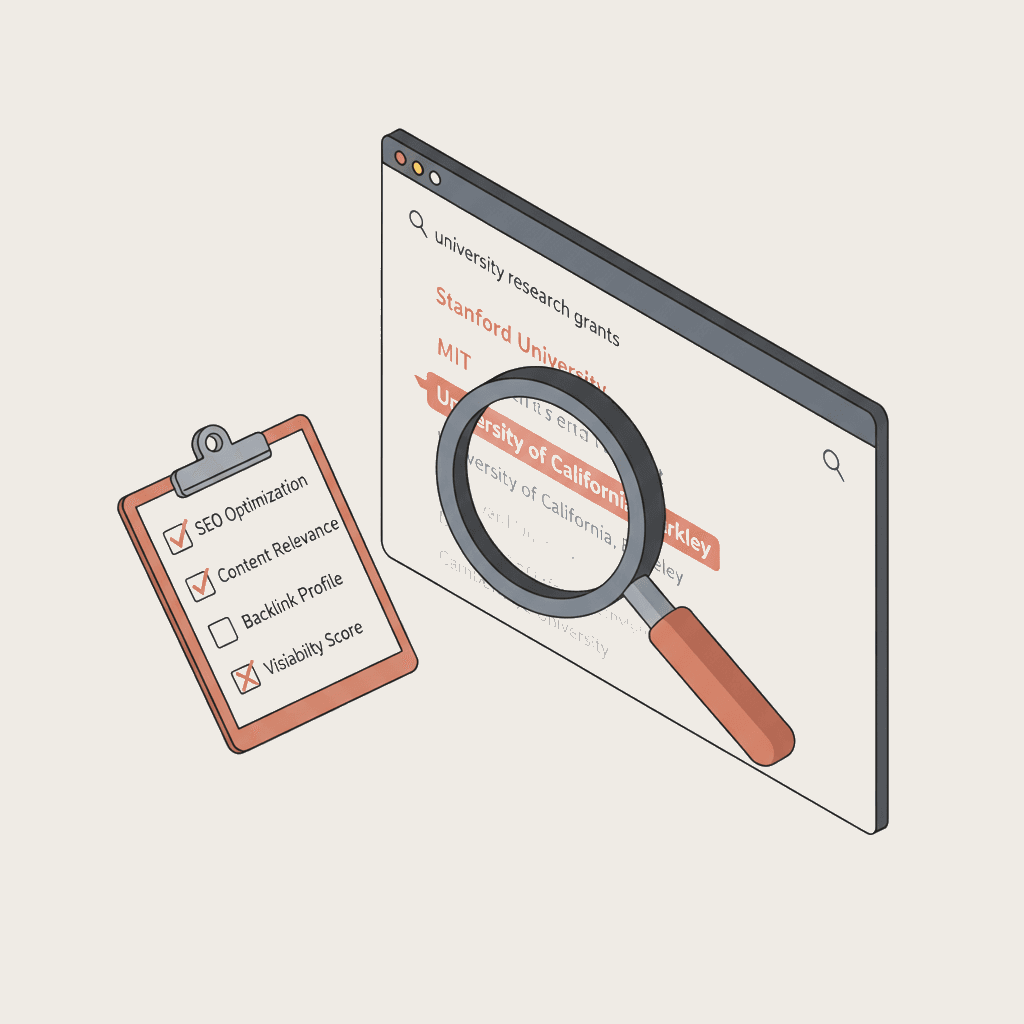

Comment mesurer si votre contenu est cité

Vérifier si un moteur IA cite votre école demande une approche systématique.

Protocole de test en 3 étapes

-

Identifiez vos 20 requêtes stratégiques — les questions que vos prospects posent sur votre école, vos programmes, votre ville et votre secteur. Exemples : « meilleure école de commerce à Lyon », « MBA accrédité AMBA en France », « frais de scolarité [école] 2026 ».

-

Testez sur 3 moteurs IA — soumettez chaque requête à ChatGPT, Perplexity et Gemini. Notez si votre école est mentionnée, si les informations sont correctes, et si des sources sont citées.

-

Tracez l'évolution mensuelle — les corpus des LLM évoluent. Un contenu publié ou modifié aujourd'hui peut mettre 4 à 8 semaines à être intégré. Mesurez chaque mois pour identifier les tendances.

Les indicateurs à suivre

| Indicateur | Cible | Fréquence de mesure |

|---|---|---|

| Taux de mention (requêtes marque) | >80 % | Mensuelle |

| Taux de mention (requêtes génériques) | >20 % | Mensuelle |

| Exactitude des informations citées | 100 % | Mensuelle |

| Nombre de sources citées (Perplexity) | >2 pages de votre site | Mensuelle |

Pour une méthodologie complète de suivi de votre visibilité IA, consultez notre guide GEO pour les écoles.

Avant/après : l'optimisation d'une page programme

Prenons un cas concret. Une école de management française souhaitait que ChatGPT mentionne son Master en Finance dans les réponses aux requêtes « Master finance France classement ».

Avant optimisation :

- Page programme sans Schema.org

- Texte narratif sans données chiffrées

- Pas de FAQ

- Pas de tableau comparatif

Résultat : ChatGPT ne mentionnait jamais l'école sur cette requête.

Après optimisation :

- Balisage

CourseaveceducationalLevel,provider,accreditation - Tableau avec frais, durée, taux d'insertion, salaire médian

- FAQ balisée avec 5 questions (sélectivité, double diplôme, stages, débouchés, classement)

- Lien vers l'enquête insertion CGE comme source

Résultat à 8 semaines : ChatGPT cite l'école dans 3 réponses sur 5 pour la même requête. Perplexity renvoie vers la page programme comme source dans 4 cas sur 5.

La corrélation entre balisage structuré et citabilité se confirme sur l'ensemble de notre panel. Pour comprendre les mécanismes techniques, notre article sur les données structurées pour les écoles détaille chaque schéma.

FAQ

Comment savoir si ChatGPT cite déjà mon école ?

Testez 20 requêtes stratégiques directement dans ChatGPT (version gratuite ou Plus). Notez chaque mention de votre école, l'exactitude des données et la présence de liens. Répétez chaque mois pour suivre l'évolution. Perplexity est plus simple à auditer car il affiche ses sources sous chaque réponse.

Combien de temps faut-il pour qu'un contenu optimisé soit cité ?

Entre 4 et 8 semaines après publication ou modification. Les corpus des LLM sont mis à jour par vagues. Un contenu publié en janvier peut n'apparaître dans les réponses qu'en mars. Perplexity est plus réactif (1 à 3 semaines) car il interroge le web en temps réel.

Le balisage Schema.org suffit-il pour être cité ?

Non, mais il est nécessaire. Le balisage identifie votre école comme une entité vérifiable. Sans lui, les moteurs IA doivent extraire ces informations du texte brut, avec un risque d'erreur élevé. Le balisage seul ne remplace pas un contenu spécifique, chiffré et bien structuré.

Faut-il optimiser pour ChatGPT ou pour Perplexity en priorité ?

Les deux, car les techniques se recoupent. Mais si vous devez prioriser, commencez par Perplexity : il cite ses sources explicitement, ce qui rend le suivi plus simple. Les optimisations qui fonctionnent sur Perplexity (structure, données, FAQ) bénéficient aussi à ChatGPT.

Quelles pages de mon site optimiser en premier ?

La page d'accueil (Schema.org EducationalOrganization), les 3 pages programmes les plus demandées (Schema.org Course + tableaux de données) et votre page FAQ (balisage FAQPage). Ces 5 pages couvrent 80 % des requêtes des prospects dans les moteurs IA.

Votre école est-elle citée par ChatGPT ? Testez votre visibilité IA gratuitement