Pourquoi la qualification manuelle ne tient plus le rythme

Une école de commerce post-prépa reçoit en moyenne 8 à 12 000 demandes d'information par campagne d'admission, dont moins de 15 % deviennent des candidats actifs au SIGEM. Le reste absorbe le temps des chargés d'admission sans produire de conversion.

Le problème n'est pas le volume brut. C'est le ratio signal/bruit : une Bachelor Business Administration recrute un candidat post-bac avec un dossier, une mention, un budget familial et un calendrier d'arbitrage précis. Un Master Grande École accrédité CEFDG cible une autre population (profils post-prépa, M1 en réorientation, candidats internationaux). Les formulaires web traitent tout le monde pareil.

Résultat mesurable : les équipes admissions qualifient à la main, relancent en aveugle, et raccrochent quand le pic de JPO arrive. Les écoles membres de la CGE qui ont déployé un scoring IA récupèrent cette capacité sans recruter.

Ce que l'IA qualifie réellement (et ce qu'elle ne qualifie pas)

L'IA ne remplace pas le jugement d'un responsable admissions. Elle fait trois choses mesurables : capter les signaux d'intent en conversation, les croiser avec les critères d'éligibilité du programme, attribuer un score exploitable par le CRM.

Les cinq signaux que l'IA capte en conversation

| Signal | Exemple concret BBA/MGE | Poids typique |

|---|---|---|

| Profil académique | Bac mention, matières terminale, moyenne prépa, note TOEIC | 25 % |

| Timing | "Je dois candidater avant quelle date ?", "rentrée 2026 ou 2027 ?" | 20 % |

| Budget / financement | Questions sur frais, bourses, alternance, prêts étudiants | 20 % |

| Intention | Demande de brochure, inscription JPO, comparaison vs 2-3 écoles nommées | 20 % |

| Fit programme | Spécialisation visée, césure, double-diplôme, international | 15 % |

Un chatbot bien entraîné remonte ces données dans les 3 à 5 premiers échanges, sans formulaire imposé. Ce qu'il ne fait pas : évaluer la motivation profonde, trancher un dossier litigieux, ou remplacer l'entretien de personnalité type admissions parallèles.

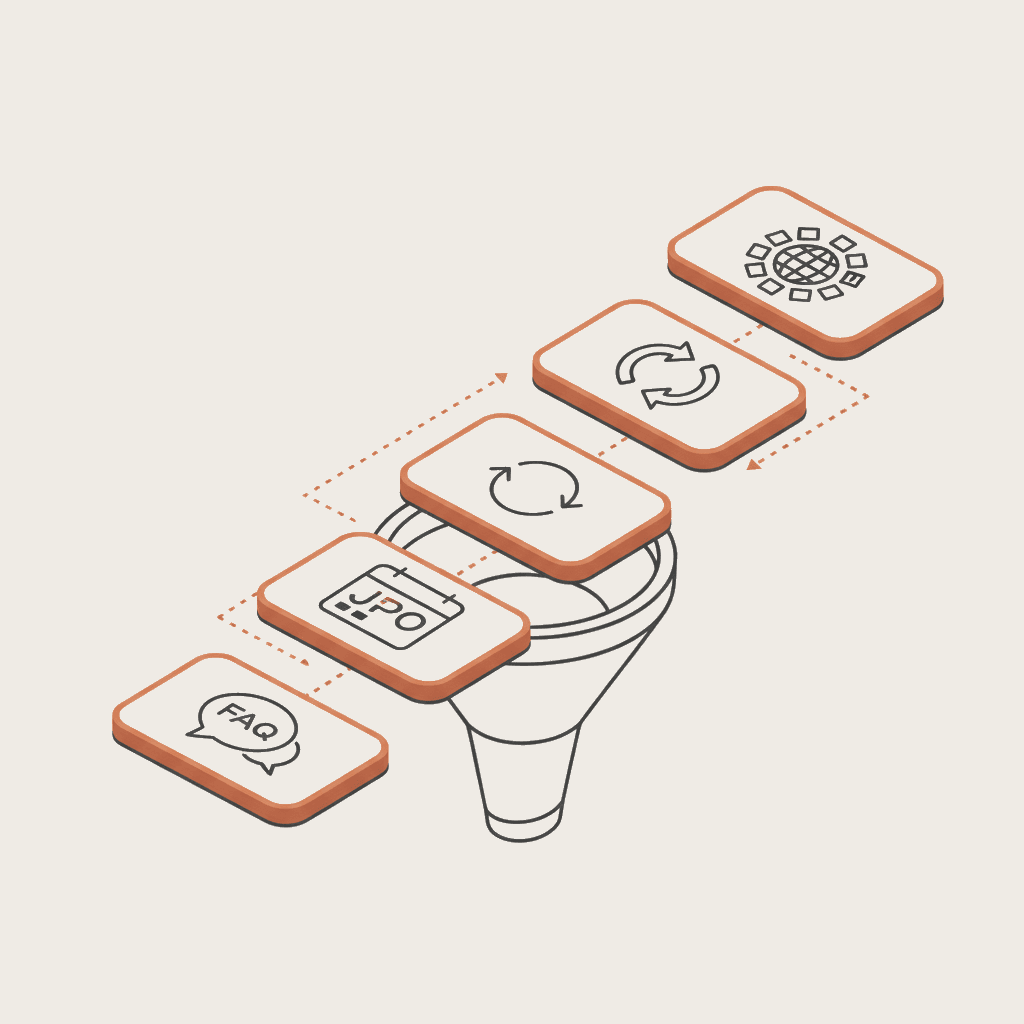

Les trois niveaux de complexité à router

Toutes les conversations n'ont pas la même valeur. La répartition observée est stable : 72 % simple FAQ / 21 % moyen contextuel / 7 % complexe humain (Source : Classification auto sur 12 000 conversations Skolbot, 2025). L'IA absorbe les deux premiers tiers et libère les chargés d'admission pour le dernier — celui où un humain fait la différence.

Comparatif des quatre approches de qualification

Pour une direction des admissions qui arbitre entre outils, voici la matrice de décision.

| Approche | Coût/an | Vitesse réponse | Précision scoring | Intégration CRM | Scalabilité |

|---|---|---|---|---|---|

| Tableur manuel + équipe | 40-80k€ (1 ETP) | 24-72h | Variable, dépend de l'ancienneté | Nulle (ressaisie) | Plafond à ~500 leads/mois |

| CRM rules-based (Salesforce, HubSpot) | 15-30k€ licences | Instantané | Rigide, seuils manuels | Native | Bonne mais scoring figé |

| Chatbot IA qualification | 12-25k€ SaaS | <2 secondes | Apprentissage continu | API / webhook | 10x+ sans recruter |

| Hybride IA + chargé d'admission | 15-30k€ + 0.5 ETP | Instantané + rappel 24h | Meilleure (IA capte, humain tranche) | Native | Optimum sur profils haut de gamme |

Pour une école post-bac type BBA à 2 000 candidats/an, le rapport coût/précision penche vers l'hybride. Pour un MGE à 500 candidats très qualifiés, le CRM rules-based peut suffire. Pour une école qui ouvre un nouveau programme et manque de données historiques, le chatbot IA est la seule option qui scale sans recrutement préalable.

Ce que ça change sur les KPIs admissions

Les gains ne sont pas marginaux quand le scoring est bien calibré. Sur un panel d'écoles équipées, les leads qualifiés passent de 120 à 195/mois (+62 %), le coût par lead chute de 42 € à 26 € (-38 %), et le taux d'inscription JPO passe de 6,2 % à 18,4 %. L'amortissement moyen se fait en 5 mois, pour un ROI 12 mois de 280 % (Source : Résultats médians sur 18 écoles, optimisations funnel concomitantes, 2024-2025).

Trois leviers expliquent ces chiffres :

- Réponse instantanée. Les prospects qui reçoivent une réponse en moins de 5 minutes convertissent 8x plus que ceux laissés 24h sans retour — un résultat cohérent avec les données Gartner sur la vitesse de réponse commerciale.

- Priorisation chirurgicale. Les chargés d'admission appellent les scores >70 en premier, pas le premier mail reçu.

- Relance ciblée. Les prospects mid-score entrent en nurturing automatisé, pas à la corbeille.

Le framework BANT adapté aux écoles de commerce

BANT (Budget, Authority, Need, Timing) vient du B2B. Transposé au recrutement d'une école de commerce post-bac, ça donne :

| Dimension BANT | Traduction école de commerce | Source de données |

|---|---|---|

| Budget | Budget famille, alternance envisagée, éligibilité bourse CROUS | Question en conversation, fiche CAF |

| Authority | Décideur : candidat, parent, co-décision | Détection linguistique ("mes parents demandent...") |

| Need | Programme ciblé, spécialisation, format (FI/FA/FC) | Clics site + questions chatbot |

| Timing | Rentrée visée, échéance Parcoursup ou admissions parallèles | Question directe + signaux calendaires |

Le chatbot IA remplit les quatre cases sur 60 à 75 % des conversations sans que le prospect ne le remarque. Un CRM ensuite route chaque lead vers la bonne séquence : admissions directes, nurturing JPO, ou orientation vers un programme adjacent si le fit est meilleur ailleurs dans le catalogue.

Intégration concrète dans le stack école

La qualification IA n'a de valeur que si elle sort du chatbot vers les outils de l'équipe admissions. Trois points d'intégration non négociables :

- CRM bidirectionnel. Le score, les transcripts et les tags de segmentation remontent via webhook dans Salesforce Education Cloud, HubSpot, ou un outil maison. À l'inverse, le statut candidat (inscrit JPO, dossier déposé, admis) redescend dans le chatbot pour éviter de re-qualifier un candidat déjà avancé.

- Parcoursup et admissions parallèles. L'IA ne peut pas lire un dossier Parcoursup, mais elle doit savoir orienter un lycéen de Terminale vers la fiche formation Parcoursup et un étudiant en L2/L3 vers le process admissions parallèles. Deux parcours radicalement différents.

- Email marketing. Les scores alimentent les segments Mailchimp/Brevo. Un prospect score 85 entre dans la séquence "relance JPO J-7", un score 40 reste en nurturing 6 mois.

Pour une BBA membre de l'AACSB, ajouter une couche de qualification multilingue change aussi le rapport aux candidats internationaux : les leads non francophones sont qualifiés sans rupture de langue, ce qui double généralement le taux de complétion de dossier.

Si vous cadrez un premier projet interne, le calcul de ROI détaillé pour un chatbot étudiant aide à poser les hypothèses budgétaires, et le panorama des scénarios chatbot qui augmentent les inscriptions montre les intégrations concrètes côté admissions. Pour situer la démarche dans un plan plus large, le guide complet du chatbot IA pour le recrutement étudiant pose les fondamentaux. Si votre établissement propose aussi des formations d'ingénieurs, voir notre comparatif chatbot école de commerce vs école d'ingénieur pour adapter la configuration à chaque public.

Trois erreurs qui tuent un projet de qualification IA

- Vouloir tout automatiser. Les 7 % de cas complexes sont ceux qui signent les meilleurs candidats. Garder un arbitrage humain clair sur ces conversations n'est pas un compromis, c'est une condition de qualité du scoring.

- Oublier le nurturing. Un lead score 40 aujourd'hui est souvent un inscrit score 80 dans 4 mois. Sans séquence email de relance brochure automatisée, 40 % du pipeline disparaît.

- Négliger la conformité RGPD. Un chatbot qui qualifie collecte des données sensibles (mention au bac, situation financière). La base légale, la durée de conservation et les mentions d'information doivent être posées avant le go-live, sous peine de sanction CNIL.

FAQ

Quelle différence entre scoring CRM classique et qualification IA ?

Le CRM scoring repose sur des règles statiques ("si JPO inscrit +20 points"). La qualification IA capte en plus le contenu des échanges, le ton, les questions implicites, et ajuste ses critères via apprentissage. Les deux se combinent : l'IA enrichit le score, le CRM l'exploite.

Combien de temps pour voir les premiers résultats ?

Les écoles qui cadrent correctement leur déploiement mesurent une amélioration du coût par lead qualifié dès le deuxième mois. Le ROI 12 mois de 280 % cité plus haut se matérialise après 5 mois d'optimisation continue du modèle.

L'IA peut-elle qualifier des candidats internationaux ?

Oui, et c'est un des cas d'usage les plus rentables. Un chatbot multilingue qualifie en anglais, espagnol, arabe ou mandarin sans rupture de parcours, ce qui résout un goulot d'étranglement classique pour les écoles accréditées AACSB ou EQUIS qui recrutent à l'international.

Que dit la CEFDG / CGE sur l'usage de l'IA en admissions ?

Ni la CEFDG ni la CGE n'interdisent l'usage d'outils IA en phase de qualification de prospects. Les contraintes portent sur la phase de sélection (équité, non-discrimination, traçabilité) et le respect du RGPD. Tant que l'IA qualifie et ne décide pas de l'admission, l'usage est conforme.

Comment mesurer la qualité du scoring dans le temps ?

Trois indicateurs à suivre mensuellement : taux de conversion par tranche de score (un score 80 doit convertir significativement plus qu'un 40), taux de faux positifs (candidats score >70 qui n'inscrivent pas), et taux de faux négatifs (candidats score <40 qui finissent par s'inscrire). Un modèle mature maintient un écart de conversion d'au moins 4x entre tranche haute et tranche basse.

Testez gratuitement la visibilité IA de votre école Testez Skolbot sur votre école en 30 secondes