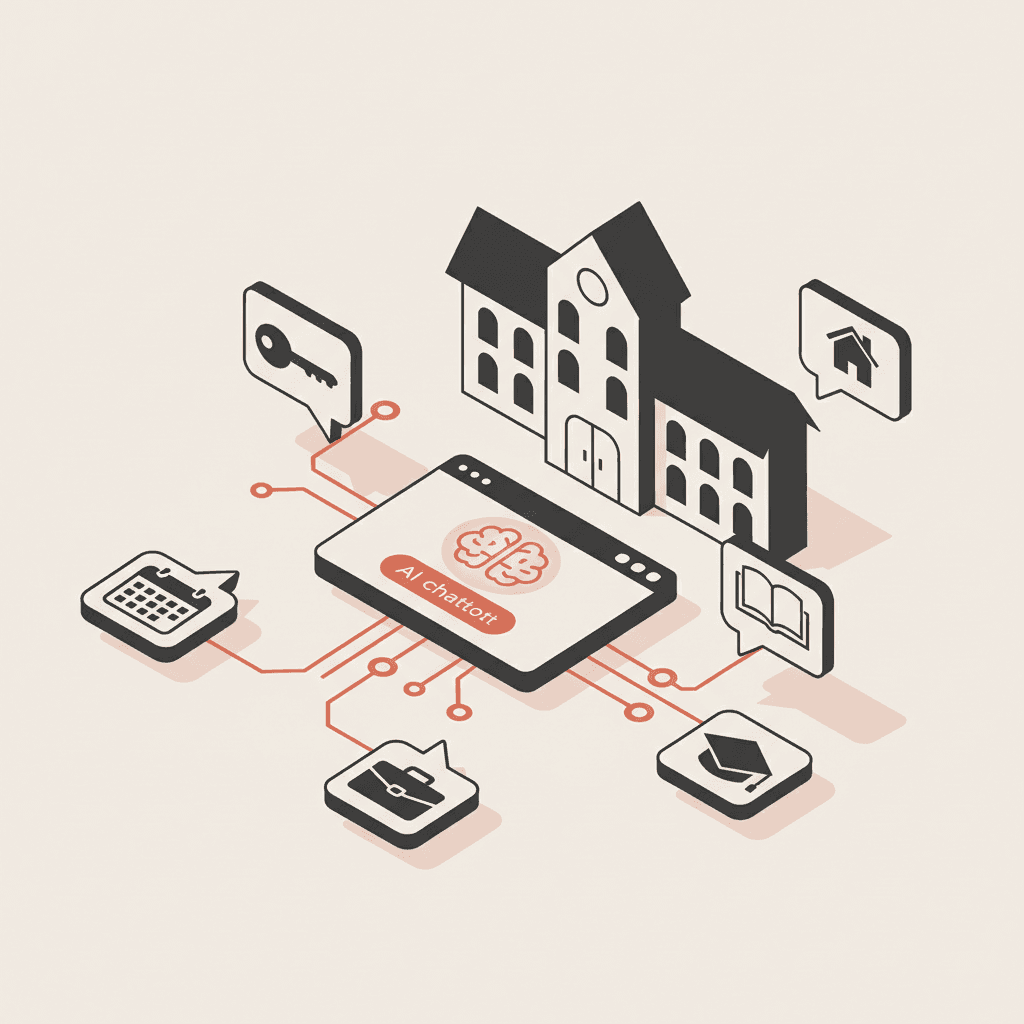

Um chatbot genérico responde às perguntas de qualquer escola. Um chatbot treinado com os dados da sua escola responde às perguntas dos seus candidatos — com os nomes dos seus cursos, os valores das suas propinas, os requisitos de acesso do seu plano curricular e as datas das suas jornadas de portas abertas. A diferença não é cosmética: é a razão pela qual 72% das perguntas dos candidatos são FAQ simples que um chatbot IA pode automatizar quando a base de conhecimento está correcta, contra menos de 30% com um chatbot de prateleira sem treino institucional (Fonte: classificação automática de 12.000 conversas Skolbot, 2025).

Este guia explica, passo a passo, como transformar os documentos da sua escola num chatbot que responde com precisão, sem alucinações e em conformidade com o RGPD.

Para uma visão global do papel do chatbot no recrutamento estudantil, consulte o nosso Chatbot IA para escolas: o guia completo.

Porquê o treino com dados próprios muda tudo

Um chatbot sem dados institucionais é um motor de linguagem sem direcção. Sabe conversar — não sabe o que a sua escola oferece.

A distinção prática é imediata. Um candidato ao Mestrado em Gestão da sua instituição pergunta: "Qual é o valor das propinas para estudantes não-comunitários?" Um chatbot genérico devolve uma estimativa vaga baseada em médias nacionais. Um chatbot treinado com os dados da sua escola responde com o valor exacto, o prazo de pagamento por prestações e o link para o requerimento de bolsa — tudo retirado dos documentos que a própria instituição forneceu.

O impacto no funil é mensurável. As escolas com chatbot IA reduzem o abandono no primeiro contacto de 91% para 76%, gerando +167% mais primeiros contactos (Fonte: análise do funil em 30 escolas, coorte 2025-2026). Esta diferença explica-se em grande parte pela qualidade das respostas: um candidato que recebe uma resposta vaga abandona; um candidato que recebe informação precisa e relevante avança no funil.

O treino com dados próprios é também o que diferencia o seu chatbot dos chatbots que os seus concorrentes já têm no site. A vantagem competitiva não está em ter um chatbot — está em ter um chatbot que conhece a sua escola melhor do que qualquer outro sistema.

Que dados usar: a matéria-prima do seu chatbot

A base de conhecimento de um chatbot para o ensino superior tem quatro camadas. Cada camada serve um tipo diferente de pergunta dos candidatos.

Camada 1 — Informação curricular e de candidatura

É o núcleo da base de conhecimento. Inclui:

- Fichas de curso: denominação exacta (Licenciatura, Mestrado, Doutoramento), área CNAEF, carga horária, regime (diurno, pós-laboral, e-learning), duração e número de vagas

- Requisitos de admissão: provas de ingresso exigidas, classificação mínima, equivalências aceites para candidatos com graus estrangeiros, regime de acesso para maiores de 23 anos

- Propinas e taxas: valores por ciclo de estudos, modalidades de pagamento, condições de isenção e bolsas internas

- Planos curriculares: unidades curriculares por semestre, opções e especializações disponíveis

- Acreditações A3ES: estado da acreditação de cada ciclo de estudos, constante na plataforma pública da A3ES (Agência de Avaliação e Acreditação do Ensino Superior)

Camada 2 — Informação do processo de candidatura

Aqui entram os documentos relacionados com o acesso ao ensino superior em Portugal:

- Prazos e fases do concurso nacional de acesso gerido pela DGES (Direção-Geral do Ensino Superior)

- Procedimento de candidatura para regimes especiais (trabalhadores-estudantes, candidatos internacionais, titulares de diplomas estrangeiros)

- Documentação necessária para cada regime

- Prazos internos de candidatura para cursos fora do concurso nacional

Camada 3 — Vida académica e serviços

Os candidatos não perguntam apenas sobre cursos. Perguntam sobre o campus, as instalações, a empregabilidade e o apoio social:

- Serviços de acção social e bolsas de estudo disponíveis

- Protocolos de estágio e parceiros empresariais

- Mobilidade internacional e programas Erasmus+

- Associação de estudantes e actividades extracurriculares

- Serviços de apoio ao estudante (psicológico, acessibilidade, desporto)

Camada 4 — FAQ institucional

A camada mais directamente utilizável: as perguntas que a equipa de admissões responde todos os dias. Se a sua escola já tem uma página de FAQ no site, é o ponto de partida — mas raramente é suficiente. Comece por auditar os emails de candidatos dos últimos 12 meses e extraia as 50 perguntas mais repetidas. Essas perguntas, com as respectivas respostas validadas, são o alicerce mais valioso da base de conhecimento.

Preparar os dados: limpeza, formatação e estruturação

A qualidade das respostas do chatbot é directamente proporcional à qualidade dos dados que recebe. Um PDF mal estruturado, com cabeçalhos em imagem ou tabelas digitalizadas, produz extracção de texto imperfeita e, consequentemente, respostas incorrectas.

Siga estas etapas antes de carregar qualquer documento:

| Etapa | O que fazer | Erros frequentes a evitar |

|---|---|---|

| Auditoria de fontes | Listar todos os documentos disponíveis e verificar a sua data de actualização | Usar fichas de curso do ano lectivo anterior com propinas desactualizadas |

| Conversão de formato | Converter PDFs digitalizados em PDF com texto pesquisável (OCR) | Carregar imagens de tabelas que o sistema não consegue ler |

| Normalização de termos | Uniformizar a denominação dos cursos (ex.: "Lic. Gestão" → "Licenciatura em Gestão de Empresas") | Variações de nome do mesmo curso em documentos diferentes geram respostas contraditórias |

| Segmentação por tema | Dividir documentos longos em secções temáticas coerentes | Um único ficheiro com 200 páginas de regulamentos mistura contextos e degrada a precisão |

| Validação humana | A equipa de admissões valida as respostas geradas pelo chatbot para as 20 perguntas mais críticas | Publicar sem teste com perguntas reais da equipa |

| Controlo de versões | Etiquetar cada documento com data de validade e responsável de actualização | Propinas actualizadas no site mas não na base de conhecimento do chatbot |

Um detalhe frequentemente ignorado: remova os dados pessoais de candidatos de todos os documentos antes de os carregar na base de conhecimento. Formulários de candidatura preenchidos, emails de candidatos ou fichas de matrícula individuais nunca devem integrar o treino do chatbot — abordaremos a conformidade RGPD em detalhe abaixo.

Metodologia de treino: RAG ou fine-tuning?

Para a grande maioria das instituições de ensino superior, a abordagem correcta é RAG — não fine-tuning. Explicamos porquê de forma simples.

RAG (Retrieval-Augmented Generation)

RAG significa que o chatbot, quando recebe uma pergunta, vai primeiro pesquisar na base de conhecimento da sua escola os documentos mais relevantes e depois usa essa informação para formular a resposta. É o equivalente a dar ao chatbot uma biblioteca com todos os documentos da sua escola e deixá-lo consultar o que precisa antes de responder.

Vantagens para o ensino superior:

- Actualização imediata: quando as propinas mudam, basta actualizar o documento na base de conhecimento — o chatbot passa a dar a resposta correcta sem qualquer re-treino técnico

- Rastreabilidade: é possível ver de onde veio cada resposta, o que facilita a auditoria de qualidade e a detecção de erros

- Menor risco de alucinações: o chatbot responde com base em documentos concretos, não com base em padrões estatísticos aprendidos durante o treino

- Custo e prazo: implementação em dias ou semanas, sem o custo computacional do fine-tuning

Fine-tuning

O fine-tuning consiste em re-treinar o modelo de linguagem com dados específicos da instituição, alterando os parâmetros internos do modelo. É adequado quando a escola tem um volume muito elevado de interacções e padrões linguísticos muito específicos que não constam nos modelos base.

Na prática, para uma escola privada de gestão, politécnico ou universidade de dimensão média, o fine-tuning raramente justifica o custo e a complexidade. A RAG resolve 95% dos casos de uso do ensino superior com menor risco técnico e muito maior facilidade de manutenção.

Para perceber como integrar tecnicamente o chatbot resultante no site da sua escola, consulte o nosso guia sobre como integrar um chatbot IA no site da sua escola.

Conformidade RGPD: o que pode e não pode usar em Portugal

A conformidade com o RGPD não é um obstáculo ao treino do chatbot — é uma condição de funcionamento. A CNPD (Comissão Nacional de Proteção de Dados) publicou orientações específicas sobre o uso de IA e chatbots que as instituições de ensino superior devem consultar antes de qualquer implementação.

O que pode usar para treinar o chatbot

- Informação pública da instituição: fichas de curso, planos curriculares, regulamentos académicos, informação de propinas — tudo o que está no site ou em brochuras públicas

- Documentação interna sem dados pessoais: regulamentos internos, procedimentos de candidatura, guias de boas-vindas, FAQs internas validadas pela equipa

- Transcrições de conversas anonimizadas: conversas de candidatos com dados pessoais removidos ou pseudonimizados, que permitem identificar padrões de perguntas sem comprometer a privacidade individual

O que não pode usar

- Dados pessoais identificáveis de candidatos: nome, email, número de identificação civil, dados financeiros de candidatos individuais

- Dados sensíveis: saúde, situação financeira detalhada, dados de candidatos menores sem consentimento explícito dos tutores

- Conversas de candidatos sem base jurídica documentada: mesmo que tecnicamente acessíveis no CRM, a utilização de conversas para treino exige base jurídica adequada e, na maioria dos casos, consentimento explícito

Obrigações práticas

Antes de implementar um chatbot treinado com dados institucionais, a escola deve:

- Realizar uma AIPD (Avaliação de Impacto sobre a Protecção de Dados) — obrigatória para tratamentos de dados em grande escala ou com recurso a IA, nos termos do artigo 35.º do RGPD

- Documentar a base jurídica do tratamento — tipicamente execução de contrato (para candidatos já matriculados) ou interesse legítimo (para candidatos potenciais), com ponderação documentada

- Actualizar o registo de actividades de tratamento nos termos do artigo 30.º do RGPD

- Assegurar um DPA (Data Processing Agreement) com o fornecedor do chatbot que garanta o cumprimento das exigências do RGPD europeu, incluindo a localização dos servidores e as condições de sub-processamento

Para uma checklist completa de conformidade RGPD para a sua instituição, consulte as orientações disponíveis na CNPD.

Melhoria contínua: como as conversas reais tornam o chatbot mais preciso

O treino inicial com documentos é o ponto de partida — não o ponto de chegada. As conversas reais com candidatos são a fonte mais valiosa para melhorar a base de conhecimento ao longo do tempo.

Segundo análises de adopção de IA em contexto empresarial publicadas pelo Gartner, os sistemas de IA generativa atingem a maturidade operacional tipicamente entre 6 e 18 meses após a implementação inicial, à medida que os ciclos de feedback real são incorporados no sistema.

Para o ensino superior, este ciclo de melhoria tem três dimensões práticas:

1. Análise das perguntas sem resposta

Toda a pergunta que o chatbot não conseguiu responder adequadamente é um sinal de lacuna na base de conhecimento. Um painel de análise semanal deve identificar estas lacunas e orientar a equipa de admissões para a produção de novo conteúdo. Exemplos típicos: regulamentação de equivalências de graus estrangeiros, detalhes de protocolos de estágio específicos, condições de acesso a apoios sociais da instituição.

2. Calibração dos tópicos de escalada

Se o chatbot escala sistematicamente certas perguntas para a equipa humana, é provável que a base de conhecimento não cubra esses tópicos com suficiente detalhe. A análise dos tópicos de escalada orienta o enriquecimento prioritário da base de conhecimento. Para perceber quando a escalada para agente humano é genuinamente necessária, consulte o nosso artigo sobre chatbot IA vs conselheiro humano: quando passar o testemunho?

3. Actualização sazonal alinhada com o calendário académico

O calendário do ensino superior tem picos previsíveis: fase de candidaturas DGES em julho, período de matrículas em setembro, início do período de candidaturas ao mestrado, épocas de dias abertos. Cada fase tem um conjunto de perguntas diferente. Um calendário de actualização da base de conhecimento alinhado com estas fases garante que o chatbot está sempre preparado para o volume e o tipo de perguntas de cada momento.

| Período | Perguntas dominantes | Documentos a actualizar |

|---|---|---|

| Março — Maio | Requisitos de candidatura, prazos DGES, provas de ingresso | Fichas de curso, guia de acesso DGES |

| Junho — Julho | Colocação, vagas, alternativas em caso de não colocação | Guias de candidatura, prazos de segunda fase |

| Agosto — Setembro | Matrícula, propinas, alojamento, início do ano | Regulamento académico, guia do estudante |

| Outubro — Novembro | Mestrados e pós-graduações, equivalências, candidatura internacional | Fichas de mestrado, requisitos internacionais |

| Janeiro — Fevereiro | Candidaturas precoces, dias abertos, visitas de estudo | Programa de dias abertos, fichas actualizadas |

Perguntas frequentes

Que quantidade de documentos é necessária para treinar o chatbot de forma eficaz?

Não há um número mínimo universal, mas a experiência com instituições parceiras sugere que uma base de conhecimento funcional para uma escola de dimensão média exige entre 30 e 80 documentos estruturados, cobrindo os cursos disponíveis, o processo de candidatura e as FAQ institucionais. Qualidade e actualidade dos documentos pesam mais do que a quantidade: 20 fichas de curso bem estruturadas e actualizadas superam 200 páginas de regulamentos mal formatados.

Como evitar alucinações nas respostas do chatbot?

A abordagem RAG reduz significativamente o risco de alucinações porque ancora cada resposta em documentos concretos da instituição. Os casos residuais de alucinação ocorrem quando a pergunta está fora do âmbito dos documentos disponíveis — nestes casos, o chatbot deve ser configurado para reconhecer os limites do seu conhecimento e propor a escalada para a equipa humana, em vez de especular. Um painel de monitorização com revisão periódica das respostas geradas é a salvaguarda operacional mais eficaz.

Posso usar os emails de candidatos para melhorar a base de conhecimento?

Apenas com anonimização rigorosa e base jurídica adequada. Os padrões de perguntas extraídos de emails (sem qualquer dado pessoal identificável) são úteis para identificar lacunas na FAQ. O conteúdo dos emails individuais, incluindo o nome, email e dados do candidato, nunca deve integrar directamente a base de conhecimento. Consulte as orientações da CNPD e assegure a conformidade com o RGPD antes de qualquer utilização de dados de conversas.

Com que frequência devo actualizar a base de conhecimento?

Existem duas dimensões de actualização: a actualização reactiva (sempre que um dado muda — propinas, prazos, vagas disponíveis) e a actualização proactiva sazonal (antes de cada fase crítica do calendário académico). A actualização reactiva deve ter um responsável designado na equipa de admissões com acesso directo à base de conhecimento. A actualização sazonal deve constar no calendário de marketing e admissões da instituição.

O chatbot pode responder a perguntas sobre acreditação A3ES e reconhecimento de graus pela DGES?

Sim, se a base de conhecimento incluir a informação pública disponível na A3ES sobre o estado de acreditação dos ciclos de estudos da instituição, e os procedimentos de reconhecimento de graus estrangeiros publicados pela DGES. O chatbot deve apresentar esta informação de forma factual e remeter para as fontes oficiais para confirmação — especialmente em casos de acreditação condicional ou procedimentos de reconhecimento, onde a orientação de um assessor humano é recomendável.

Teste gratuitamente a visibilidade IA da sua escola Teste o Skolbot na sua escola em 30 segundos